日前,人工智能顶会 ICLR 2026 最新收录名单发布,江行智能凭借物理 AI领域的持续创新,两项世界模型研究成果成功入选,攻克多任务、高保真、高效率协同难题,进一步巩固公司在工业物理 AI赛道的技术领先性。

在具身智能与通用机器人快速发展的背景下,世界模型已成为 AI 理解物理常识、实现样本高效学习的核心技术,但传统方案在复杂工业场景中难以平衡多任务适配、图像还原精度与模型运算效率,无法满足物理 AI 与工业现场的实际应用要求。

江行智能本次推出的 MoW 与 OC-STORM 两项创新成果,分别从模型架构与视觉表征层面实现系统性突破:

MoW:专才协作,决胜全局

针对多任务学习普遍存在的固有矛盾,传统单一模型难以兼顾多元任务需求,易产生性能权衡短板。MoW 创新构建世界模型混合专家架构,摒弃通用型单模型的设计思路,转而培育差异化专精的子专家模型,并通过动态调度机制实现智能协同组合。

该架构主要由三大核心模块构成:一是专家池,搭载共享基础层、配备独立适配单元的轻量化世界模型,各专家模型分别聚焦特定任务与场景,形成专业化能力分工;二是路由网络,作为轻量化调度单元,可结合实时环境上下文,稀疏且精准激活适配当前场景的核心专家;三是协同预测模块,整合多组激活专家的输出结果,完成高精度世界状态推演。依托模块化协同架构,MoW 在 Atari 100k 多任务基准测试中表现优异,综合性能全面优于传统单一模型,无限逼近分任务独立训练的性能理论上限,同时有效控制模型参数量与运算开销,在多任务场景下实现效果、效率与成本的多维平衡。

OC-STORM:洞察本质,以简驭繁

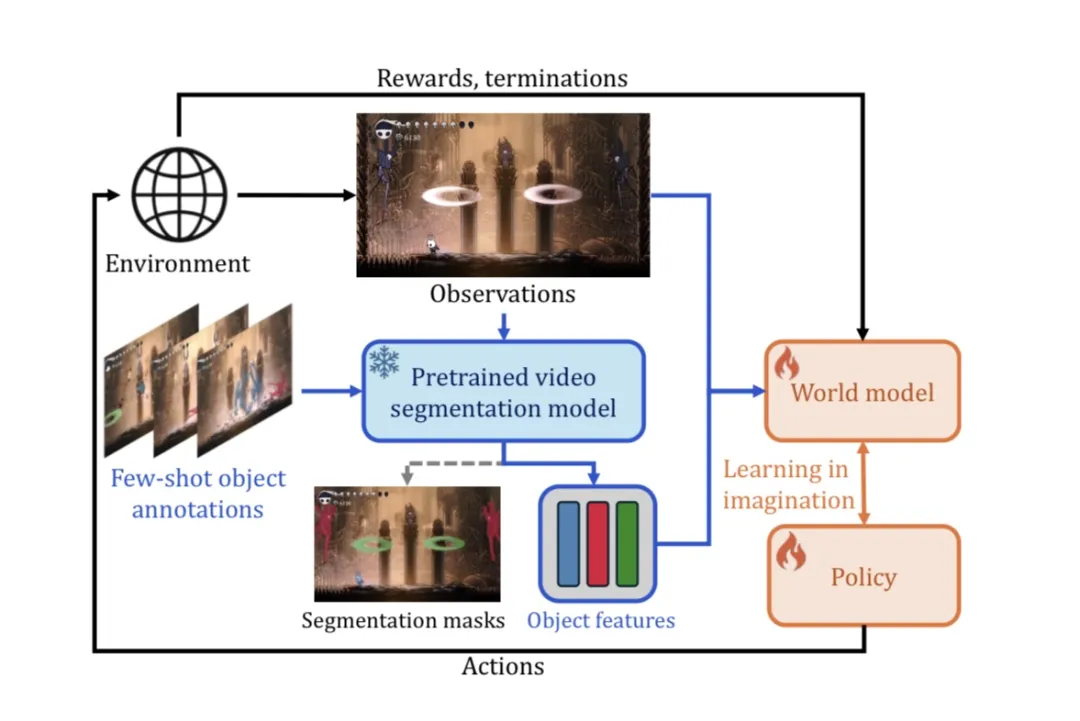

高保真视频预测任务,要求模型精准解析场景内个体运动规律与动态交互关系。OC-STORM 实现技术突破,将物体中心化视觉表征理念与 STORM 先进世界模型架构深度融合,构建全新视频预测范式。

模型依托视觉编码器,逐帧拆解画面信息,生成离散化、物体维度的独立潜在表征;再基于结构化物体表征完成时序学习与逻辑推理,预判物体未来状态演变;最终通过解码器,依据预测结果重构高清未来画面。

该架构使模型脱离无序像素级学习局限,聚焦物体本质运动特征与物理交互逻辑,显著强化推理精度与通用泛化能力。在长时程视频预测场景中,OC-STORM 画面清晰度与时序一致性表现位居行业前列,为各类高精度物理推演场景,筑牢高阶视觉感知技术底座。

这些技术突破直接指向工业物理 AI核心痛点:MoW 支撑工业智能大脑灵活适配巡检、操作、诊断等多样化任务,实现跨场景知识共享与快速扩展;OC-STORM 解决工业现场背景复杂、目标细小、数据稀缺等问题,提升设备状态监测与异常预判能力。

未来,江行智能将继续以物理 AI为核心方向,深化世界模型、具身智能与工业场景的融合创新,持续把前沿技术转化为可落地、可复制、可演进的工业物理 AI解决方案,与生态伙伴携手推动人工智能成为千行百业的新型生产力。